Anton Grabolle / Better Images of AI / AI Architecture / CC-BY 4.0

Lees ook

Een uitgeklede AI wetgeving

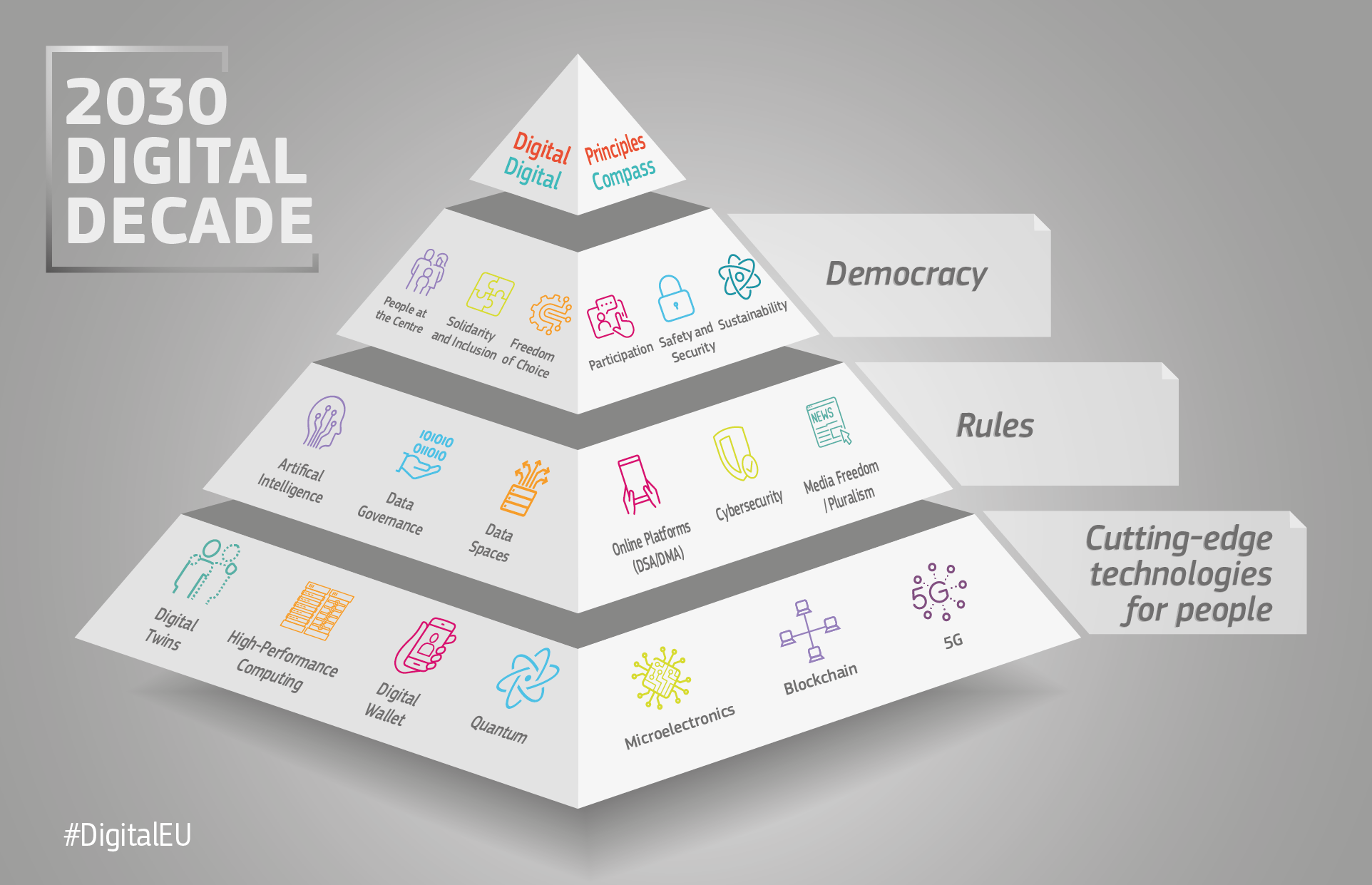

Op 9 december 2023 hebben vertegenwoordigers van het Europese Parlement, de Europese Raad en de Europese Commissie overeenstemming bereikt over de inhoud van de AI Act. Deze wet legt de regels vast voor de toepassing van Kunstmatige Intelligentie/ Artificial Intelligence (AI) in Europa én de toepassing op ingezetenen van Europa. Het vormt één van de onderdelen van de Europese Data Strategie.

Winst- en verliespunten

Enerzijds wordt de wet gezien als een ‘huzarenstukje’ omdat het de eerste wetgeving in de wereld is die de toepassing van AI vastlegt; anderzijds is er veel kritiek op de daadwerkelijke bescherming die de wet gaat bieden aan EU burgers. Nieuwssite Euractive somt een aantal winst- en verliespunten op:

- Een ban op ‘predictive policing software’ (denk aan de film ‘ Minority Report’ waarin de hoofdpersoon wordt achtervolgd voor een misdaad die hij in de toekomst zou gaan plegen) gebaseerd een risico inschatting op basis van persoonskenmerken

- Een ban op het herkennen van emoties op het werk en in het onderwijs (bijv. of iemand boos of agressief is) met een uitzondering voor veiligheid, zoals het herkennen van vermoeidheid bij een automobilist.

- Het verbieden van AI systemen die personen categoriseren op basis van bijzondere persoonskenmerken zoals ras, politieke- en religieuze opvattingen.

- Het gewenste verbod op real-time biometrische identificatie is op verzoek van de Europese Raad ingeruild voor nauwere justitiele uitzonderingen, bijv. om terroristische aanslagen te voorkomen of slachtoffers, danwel verdachten van een vooraf gedefinieerde lijst van misdaden te identificeren.

Use-cases

- De AI wetgeving bevat een lijst van use-cases die geacht wordt een significant risico te bevatten voor de veiligheid en fundamentele rechten van personen. De mede-wetgevers (Europese Raad en Europese Commissie) hebben een aantal filters toegevoegd zodat alleen hoog-risico applicaties hieraan worden onderworpen.

Uitzonderingen

- Justitiële organisaties (bijv. het Openbaar Ministerie) kunnen o.a. een vier-ogen-principe toepassen wanneer de toepassing van de wetgeving disproportioneel is in het licht van de wetgeving van de betreffende lidstaat, evenals een uitzondering op de transparantierichtlijnen van gevoelige operationele data.

- Leveranciers en publieke rechtspersonen (bijv. politie, douane) die hoog-risico systemen gebruiken moeten dit rapporteren in een EU-database. De database is gedeeltelijk afgesloten (bijv. t.b.v. opsporingsdoeleinden).

- In uitzonderingsgevallen, zoals openbare veiligheid, kunnen hoog-risico systemen worden gebruikt die niet vooraf juridisch zijn getoetst en geautoriseerd.

Eerdere overeenstemming

Twee dagen eerder, op 7 december 2023, was al overeenstemming bereikt over de hoofdonderdelen van de AI Act:

- De definitie van AI maakt gebruik van de belangrijkste elementen van de OECD definitie, maar herhaald deze niet woord-voor-woord. De OECD is de organisatie van economische samenwerking en ontwikkeling en is breder dan de EU.

- Gratis en open-source software valt niet onder het aandachtsgebied van de wet tenzij het als hoog-risico wordt gezien; het verboden toepassingen bevat of gebruikt kan worden voor manipulatie.

Oren laten hangen naar de techbedrijven

Brussel heeft zijn “oren laten hangen naar de techbedrijven” aldus de drie Nederlandse hoogleraren; Prins, van Dijck en Helberger in het opiniestuk “Nederland moet doen wat de EU nalaat: burgers beschermen tegen AI” in NRC (23-12-2023);

“Ondanks waarschuwingen van kopstukken in de AI-sector en wetenschappers over de mogelijk verstrekkende gevolgen van kunstmatige intelligentie voor de samenleving, blijven onder het compromisvoorstel de meeste AI-modellen grotendeels ongereguleerd”.

Bezwaren

Prins, van Dijck en Helberger benoemen o.a. de volgende bezwaren:

- “Instrumenten voor de bescherming van publieke waarden staan niet voorop in het compromis. Terwijl de technologie wel zal ‘doordringen in de haarvaten van onze samenleving’.

- Het is in principe aan de markt om ervoor te zorgen dat publieke waarden als het recht op non-discriminatie, bescherming van privacy, duurzaamheid of cyberveiligheid voldoende in acht worden genomen.

- Dat betekent dat eindgebruikers zélf de AI-toepassingen die zij van ontwikkelaars afnemen op deze waarden zullen moeten beoordelen.

- De Europese AI-wet is veel gunstiger voor de innovatiebelangen van producenten, dan voor de bescherming van burgers.

- Vanwege de teleurstellende Europese AI-wet zal de Nederlandse koers met betrekking tot generatieve AI nog belangrijker worden.

- Alleen de zeer krachtige AI-modellen zullen immers onder de nieuwe regels vallen, omdat ze een ‘hoog risico’ vormen voor de samenleving.

- ‘Hoog risico’ wordt gedefinieerd in termen van omvang (aantallen eindgebruikers) en computerrekenkracht die nodig is voor het trainen van deze modellen, en niet in termen van potentiële risico’s voor grondrechten, gezondheid en veiligheid. Kleinere AI-modellen blijven met deze nieuwe regels buiten schot”.

Tot slot doen zij een beroep op de Nederlandse overheid om burgers en organisaties via duidelijk beleid de noodzakelijke steun te geven.

Een uitwerking hiervan is de samenwerking van TNO met SURF en NFI aan een eigen Nederlands taalmodel gebaseerd op AI en Large Language Models (LLM’s). GPT-NL moet de strategische autonomie en kennis versterken op het gebied van AI, Data Science, en Data Spaces. Het is de verwachting dat de de introductie van GPT-NL Nederland straks een eigen taalmodel en ecosysteem biedt, ontwikkeld naar Nederlandse waarden en richtlijnen. TNO heeft o.a. een AI-lab opgezet dat de overheid moet gaan ondersteunen bij inspecties op het gebied van AI wordt toegepast.

The devil is in the detail – te vroeg om te juichen

Het EDRi netwerk, waarin 47+ NGO’s (waaronder Bits of Freedom) zijn vertegenwoordigt stelt dat een uitgebreidere beoordeling van de technische concept-teksten noodzakelijk is om het effect op de bescherming van burgers in de EU te beoordelen:

“the extent to which the AI Act protects people in Europe from the worst excesses of surveillance, discrimination and AI-based harms will require a fuller assessment of the technical drafts, which will surface over the next weeks.”

Een AI-manifest als kader

Met het oog op het gebrek aan beleid dat de afgelopen kabinetten hebben gedemonstreerd kunnen vraagtekens worden geplaatst bij de daadwerkelijke inspanning om deze steun te verlenen.

In de Verenigde Staten waar een vergelijkbare situatie bestaat gaan bedrijven er toe over om zelf ‘beleid’ op te stellen, zoals een manifest waarin de principes zijn vastgelegd voor het implementeren van AI. In het tijdschrift Forbes schrijft de CEO Don Schuerman van het technologiebedrijf PEGA op 21-12-2023 over de noodzaak van deze principes:

“At the same time, we’re being hit with a lot of AI doom and gloom. If we implement AI in the wrong way, we’ll either destroy all future human jobs or the Earth will instantly explode. We’re left with the conflicting messages of ‘move fast or else your company dies’ and ‘but don’t mess it up or we’ll all be extinct.’”.

Enkele van de negen principes uit het manifest, opgesteld door Peter van der Putten (@petervanderputten) benadrukken o.a. de noodzaak van een doelgerichte inzet van AI en de controlerende rol van de mens:

- Start with the real business outcomes you want to achieve to understand which AI-powered decisions and generative modelsdrive the most value.

- To minimize risk, AI strategy should prioritize human control by considering “human-in-the-loop” use cases or ensuring humans are monitoring and steering autonomous AI in play.

- Everyone will state that AI needs to be fair, transparent, safe, accurate, robust, privacy-friendly, auditable, managed, and accountable – promoting organizational benefits as well as societal and environmental well-being. You must bake these principles into your tools and best practices. (Van der Putten-The AI Manifesto).

Bronnen

- https://www.euractiv.com/section/artificial-intelligence/news/ai-act-eu-policymakers-nail-down-rules-on-ai-models-butt-heads-on-law-enforcement/

- https://www.euractiv.com/section/artificial-intelligence/news/european-union-squares-the-circle-on-the-worlds-first-ai-rulebook/

- Nederland moet doen wat de EU nalaat: burgers beschermen tegen AI. José van Dijck, Natali Helberger en Corien Prins. Opinie NRC 23-12-2023 https://www.nrc.nl/nieuws/2023/12/21/nederland-moet-doen-wat-de-eu-nalaat-burgers-beschermen-tegen-ai-a4185004

- The AI Manifesto. Nine guiding principles for responsible & trustworthy application of AI with impact. Peter van Putten. Pega.

AI Act in werking vanaf 12-07-2024

Op 12 juli 2024 is de AI Act (Regulation (EU) 2024/1689) gepubliceerd in het ” Official Journal of the European Union” nadat het de maanden ervoor was aangenomen door het Europese Parlement en de Europese Raad. De volledige wet wordt binnen 24 maanden van kracht; sommige onderdelen zullen eerder ingaan:

- verbodsbepalingen en verplichtingen inzake AI-geletterdheid die vanaf 2 februari 2025 van toepassing zijn geworden;

- de governanceregels en de verplichtingen voor AI-modellen voor algemeen gebruik worden van toepassing op 2 augustus 2025;

- de regels voor AI-systemen met een hoog risico – ingebed in gereguleerde producten – hebben een verlengde overgangsperiode tot 2 augustus 2027.

Lees in de ‘Legislative Train Schedule‘ het gehele wetgevingstraject voor de Artificial Intelligence Act.

AI-geletterdheid vanaf 2-2-2025

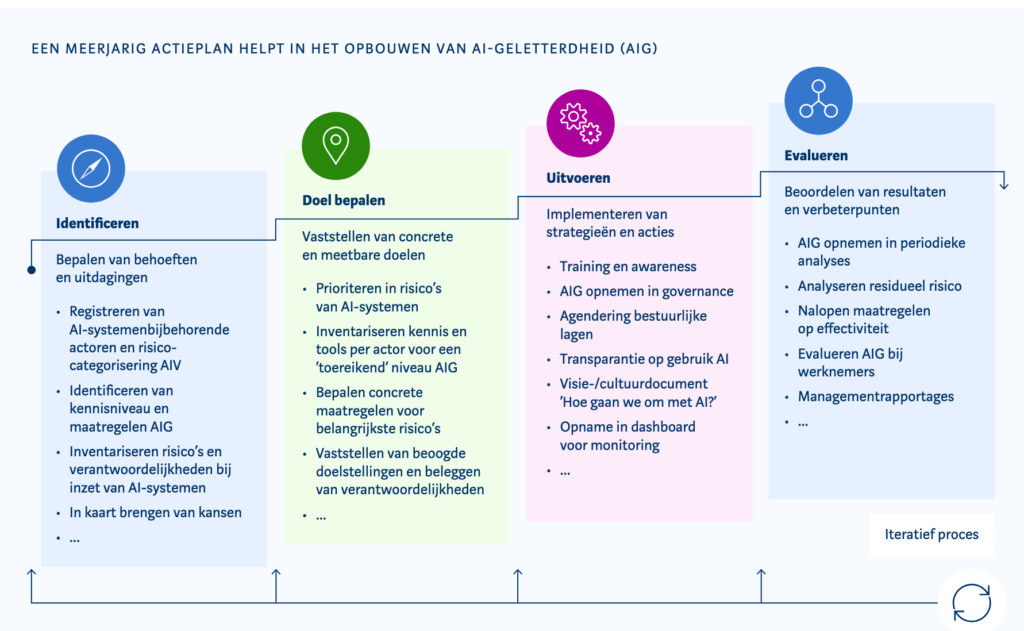

Vanaf februari 2025 moeten bedrijven en organisaties die AI systemen ontwikkelen, of gebruik maken van AI zorgdragen dat hun medewerkers voldoende kennis, vaardigheden en begrip hebben van de toepassing en inzet. Dit is in lijn met art. 4 van de AI-verordening (2024/1689). De Autoriteit Persoonsgegevens (AP) heeft een handleiding “Aan de slag met AI-geletterdheid” beschikbaar gesteld “als bouwsteen voor de beheersing van AI-systemen”. De AP merkt op dat “in de context van de AI-verordening, beleid, best practices en richtsnoeren op het gebied van AI-geletterdheid nog in ontwikkeling zijn”. De handleiding gaat uit van een zich herhalend (iteratief) proces met vier stappen: 1. Identificeren; 2. Doel bepalen; 3. Uitvoeren; 4. Evalueren.

Voorbeeld van een AI-geletterdheid programma

Welke onderdelen een AI-geletterdheid programma (AIG) moet is niet wettelijk vastgesteld en zal context- en systeemafhankelijk zijn. T.z.t. zullen hiervoor ongetwijfeld ook normen worden vastgesteld. Ontwikkeling van een AI-systeem in een zorginstelling zal andere eisen stellen dan in een onderwijsinstelling.

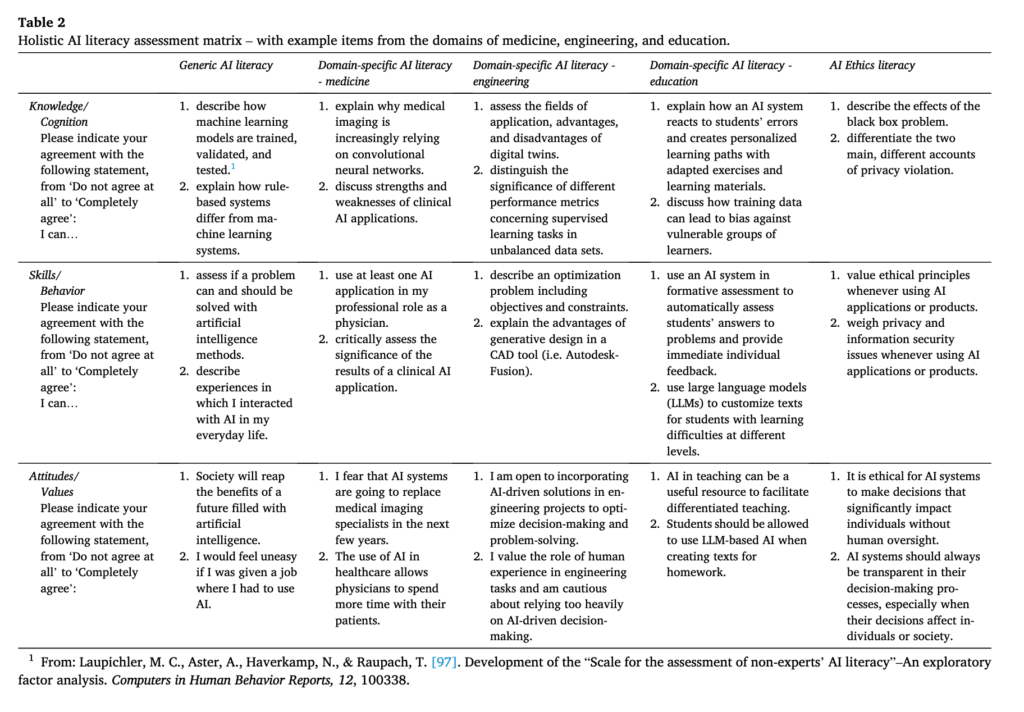

Knoth et. al (2024) hebben bijvoorbeeld een framework ontwikkeld dat gebruikt kan worden om AIG meetbaar te maken. Het gaat uit van drie competenties: vaardigheden, kennis en houding en drie typen AI: generieke AI, domein-specifieke AI en AI ethiek. In onderstaande tabel is dit framework toegepast op de domeinen geneeskunde, techniek en onderwijs.

Bronnen

- https://www.autoriteitpersoonsgegevens.nl/documenten/aan-de-slag-met-ai-geletterdheid

- Developing a holistic AI literacy assessment matrix – Bridging generic, domain-specific, and ethical competencies. Knoth, N., Decker, M., Laupichler, M. C. et. al (2024) Computers and Education Open 6 (2024) 100177 . CC BY 4.0 https://www.sciencedirect.com/science/article/pii/S2666557324000181 https://doi.org/10.1016/j.caeo.2024.100177

Verbod op specifieke AI systemen vanaf 2-2-2025

Behalve AI-geletterdheid zijn vanaf 2 februari 2025 de volgende onderdelen van de AI-Act van kracht:

1. De AI systeemdefinitie

“AI-systeem”: een op een machine gebaseerd systeem dat is ontworpen om met verschillende niveaus van autonomie te werken en dat na het inzetten ervan aanpassingsvermogen kan vertonen, en dat, voor expliciete of impliciete doelstellingen, uit de ontvangen input afleidt hoe output te genereren zoals voorspellingen, inhoud, aanbevelingen of beslissingen die van invloed kunnen zijn op fysieke of virtuele omgevingen (art. 3.1 AI verordening 2024/1689)

2. Een verbod op een beperkt aantal AI use cases die een onacceptabel risico vormen.

“Hieronder vallen bijvoorbeeld systemen en toepassingen die de vrije keuze van mensen te veel beperken, die manipuleren of die discrimineren. Denk aan systemen die worden gebruikt in of voor:

- ‘social scoring’ op basis van van bepaald sociaal gedrag of persoonlijke kenmerken;

- ‘predictive policing’om strafbare feiten bij mensen te beoordelen of te voorspellen;

- het creëren of (via scraping) uitbreiden van databanken voor gezichtsherkenning;

- manipuleren of misleiden van mensen;

- emotieherkenning in de werkomgeving en het onderwijs;

- biometrische identificatie op afstand voor rechtshandhaving. Hier zijn wel enkele uitzonderingen van toepassing;

- biometrische categorisering, waarbij mensen op basis van biometrische gegevens in bepaalde gevoelige categorieën worden ingedeeld.” (https://www.autoriteitpersoonsgegevens.nl/themas/algoritmes-ai/ai-verordening/risicogroepen-ai-verordening; 09-02-2025).

Bronnen

- https://digital-strategy.ec.europa.eu/en/news/first-rules-artificial-intelligence-act-are-now-applicable

- https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

- https://www.autoriteitpersoonsgegevens.nl/themas/algoritmes-ai/ai-verordening/risicogroepen-ai-verordening

Dit werk valt onder een Creative Commons Naamsvermelding-NietCommercieel 4.0 Internationaal-licentie.